Dopo aver assistito all’ennesima manifestazione dedicata all’elettronica di consumo in cui aziende di tutte le dimensioni cercano di guadagnarsi la propria fetta del mercato esistente o di creare nuovi mercati corrispondenti a nuovi bisogni più o meno necessari di solito il vostro cronista se ne torna a casa con una sensazione mista di entusiasmo e di rassegnazione. Quest’anno però ha prevalso un’altro sentimento: la paura.

Entusiasmo e rassegnazione sono giustificabili come già accennato negli articoli dei giorni scorsi con la dimensione crescente di eventi come il CES in cui crescono progressivamente gli espositori e diventa sempre più difficile scorrere gli immensi padiglioni: cresce pure il numero di prodotti e vengono proposte idee interessanti che possono migliorare la nostra vita di tutti i giorni unite ad una marea di oggetti inutili, ridondanti che seppure in grado di generare una notizia interessante non hanno comunque alcun senso in un quadro di progresso della tecnologia.

Il vero progresso tecnologico percepito sottotraccia al CES2017 riguarda ben altro che la disponibilità di un nuovo gadget smart ed è quello che crea nel vostro cronista la sensazione di paura: è l’uso dell’intelligenza artificiale per creare intelligenza artificiale.

Se e’ piacevole riscontrare un progresso nel riconoscimento delle immagini, della voce o nella automazione di alcuni processi ripetitivi grazie ad algoritmi sempre più capaci e potenti nelle storie raccontateci da bravissimi sviluppatori presenti a Las Vegas si intravede uno sviluppo per così dire “naturale” dell’intelligenza artificiale che pone questa evoluzione sotto una luce inquietante.

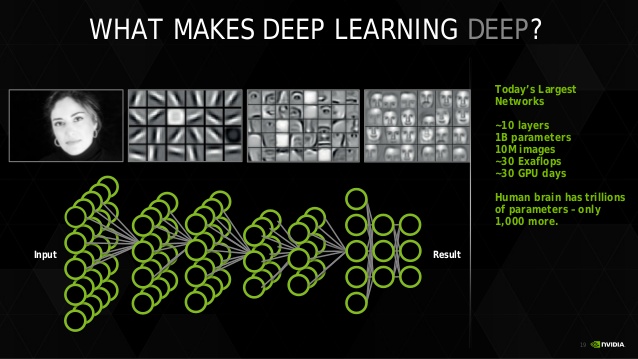

Il salto di livello è sufficientemente semplice da spiegare: gli sviluppatori sono in grado, attraverso la programmazione di reti neurali, di far comprendere alle macchine come percepire l’ambiente e a comportarsi di conseguenza: di fatto non si dovrà fornire alla macchina istruzioni passo passo per seguire un percorso o l’adattamento ad una traccia preesistente ma si dovrà fare in modo che la macchina prenda decisioni autonome in base ad una moltitudine di parametri.

Il problema è che l’algoritmo di base che insegna alla macchina le cose da fare e detta le priorità è solo la superficie esterna che descrive il comportamento: su macchine con semplici compiti da eseguire sarà possibile ricostruire un log di dimensioni più o meno grandi e analizzare quel che la macchina elabora ed intervenire su di essa in caso di errore. Ma se la macchina segue una procedura di autoapprendimento il suo comportamento e le decisioni prese sono il risultato di elaborazioni talmente complesse che sarà comodo o possibile verificare solo il risultato finale e il codice interno sviluppato sarà virtualmente impossibile da analizzare.

Il passo “naturale” successivo è questo: visto che il codice di autoapprendimento è facile da creare e il successivo sviluppo difficile da analizzare si sta lavorando a sistemi di intelligenza artificiale che creino a loro volta sistemi di intelligenza artificiale. In pratica il software non viene più progettato da umani ma da altre macchine con la stessa tecnologia ormai consolidata di “Deep Learning” che ha le sue applicazioni principali nel riconoscimento delle immagini con risultati di una qualità superiore ormai a quella delle doti umane.

Le applicazioni del Deep Learning, delle reti neurali, dell’Intelligenza artificiale che genera e controlla altra intelligenza artificiale sono una evoluzione diremmo “spontanea”, perché conveniente e semplice di macchine che oggi imparano da sole e che possono pure insegnare, da sole, ad altre macchine.

Tutto è ovviamente figlio della enorme potenza di calcolo che stiamo raggiungendo anche nei dispositivi più semplici e comuni e del progresso nella ricerca sull’intelligenza artificiale ma siamo sicuri che la delega a macchine sempre più autonome e in grado di autoprogettarsi sia un bene per l’umanità o una rinuncia ad un potere decisionale o di controllo che una programmazione “lineare” ci ha garantito fino ad oggi?

La paura non è ovviamente per il progresso delle capacità di elaborazione ma per l’uso distorto che potrebbe risultare anche con un investimento minimo di risorse e capitale umano per scopi di sopraffazione e di controllo delle nostre vite o semplicemente della progressiva necessità, comodità ed economicità di affidarsi unicamente a delle macchine per importanti scelte decisionali.

Così mentre stiamo alfabetizzando i piccoli umani con l’insegnamento basilare del coding in qualche laboratorio universitario e pure in qualche piccola società privata di informatica avanzata c’è chi sta insegnando alle macchine a fare a meno dei programmatori, decidendo come le macchine stesse debbano autoeducarsi.